- El principio que lo resume todo

Google, IBM y Andrew Ng coinciden en señalar lo mismo como el fundamento de cualquier buen prompt: claridad, concreción y especificidad.

No es suficiente saber lo que quieres. Hay que saber decírselo a la IA de una forma que no deje margen para la ambigüedad.

La diferencia entre un prompt vago y uno bien construido no es cuestión de estilo. Es la diferencia entre una respuesta genérica e inútil y una respuesta ajustada a tu contexto, lista para usar.

- Las cuatro dimensiones de un buen prompt (según IBM)

IBM identifica cuatro elementos que cualquier instrucción debería incluir:

- Claridad: que la tarea esté expresada de forma inequívoca.

- Contexto: información sobre quién eres, para qué necesitas lo que pides y en qué situación te encuentras.

- Precisión: detalles concretos que acotan el resultado esperado.

- Rol: indicar qué papel debe adoptar la IA para responder.

De los cuatro, el contexto es el más ignorado. La mayoría de usuarios asumen que la IA va a deducir el escenario, y eso raramente funciona. Una instrucción sin contexto obliga al modelo a rellenar huecos, y cuando lo hace, se equivoca.

- Por qué el contexto cambia el resultado

Compara estos dos prompts para pedir un post de LinkedIn:

- «Escríbeme un guión sobre “la luna nueva en Tauro” para un video de Youtube.»

- «Soy astrólogo profesional especializado en técnicas predictivas. Mi audiencia son personas con poco estudio o conocimiento en astrología. Quiero escribir un guión sobre cómo puede beneficiar una luna nueva en tauro según cada signo zodiacal, con un enfoque práctico y en un máximo de 10 minutos de exposición.»

El segundo prompt no es más largo por casualidad. Cada elemento añadido (perfil profesional, audiencia, tema, enfoque, extensión) reduce el espacio de interpretación del modelo y aumenta la probabilidad de obtener algo directamente útil.

Regla de Google: cuanto más contexto das, menos tiene que adivinar la IA. Y cuando adivina, se equivoca. La mayoría de respuestas genéricas o incorrectas son simplemente consecuencia de falta de contexto.

- Mostrar en lugar de describir: el Fusion Prompting

Hay situaciones en las que describir con palabras lo que quieres resulta insuficiente, especialmente cuando buscas un tono o un estilo muy específico. Para eso existe el Fusion Prompting, una técnica popularizada por Andrew Ng que consiste en proporcionar ejemplos en lugar de instrucciones abstractas.

El funcionamiento es el siguiente:

- Selecciona dos o tres ejemplos que ilustran exactamente el estilo, tono o formato que buscas.

- Se los proporcionas a la IA junto con el nuevo tema o tarea.

- Le pides que genere el resultado siguiendo el mismo patrón.

Los ejemplos no tienen que ser perfectos. Solo necesitan tener el formato correcto y en cantidad suficiente para que el modelo pueda identificar el patrón.

IBM lo resume así: mostrar es mejor que decir. Un ejemplo concreto transmite más información que una descripción larga.

- Ayudar al modelo a razonar: la cadena de pensamiento

Los modelos de lenguaje, por defecto, tienden a responder lo primero que se les ocurre. Para tareas simples, esto funciona bien. Para tareas complejas, puede generar errores en cadena: si el modelo comienza con una premisa equivocada, todo lo que construye sobre ella tiende a estar mal.

La solución es indicarle que razone paso a paso antes de responder. Esto se conoce como zero-shot chain of thought y se aplica simplemente añadiendo una indicación como «piensa paso a paso» al final del prompt.

La versión más potente es el few-shot chain of thought: en lugar de pedirle que razone, le proporcionas un ejemplo de un problema similar ya resuelto paso a paso. El modelo aprende tu método de razonamiento y lo aplica al nuevo problema.

Nota importante: con los modelos razonadores actuales, que son la mayoría, el razonamiento paso a paso ocurre de forma automática. Pedírselo explícitamente puede generar respuestas más largas y redundantes. Lo que sigue siendo útil es detallar las etapas clave del proceso que quieres que siga.

- Explorar varias soluciones a la vez: el árbol de pensamientos

La cadena de pensamiento sigue un camino lineal de razonamiento. Pero hay problemas en los que no hay una única solución correcta, sino varias estrategias posibles y conviene explorarlas antes de elegir.

Para eso existe el Tree of Thought (árbol de pensamientos), una técnica avanzada que consiste en pedirle al modelo que desarrolle varias líneas de razonamiento en paralelo, evalúe cada una y recomiende la más adecuada según los criterios establecidos.

Es especialmente útil para:

- Decisiones estratégicas con múltiples variables.

- Escenarios creativos donde hay varias opciones válidas.

- Problemas donde quieres ver el panorama completo antes de comprometerte con una dirección.

El prompt debe especificar cuántas estrategias quieres que explore, qué criterios debe seguir para desarrollar cada una y que al final emita una recomendación justificada.

- Iterar: el primer prompt es solo el comienzo

El 90% de los usuarios escribe un prompt, obtiene un resultado mediocre y concluye que la IA no sirve. Los usuarios que realmente aprovechan la herramienta saben que el primer prompt rara vez es el definitivo. La calidad de las respuestas mejora con la iteración.

Google propone cuatro formas de mejorar un prompt que no ha funcionado:

- Revisar si falta contexto o rol: ¿le dijiste quién eres o para qué necesitas la respuesta?

- Dividir instrucciones largas: si el prompt tiene diez líneas mezcladas sin estructura, es difícil para el modelo seguirlo. Separa el contexto de las instrucciones.

- Cambiar el enfoque: si una formulación no funciona, intenta otra. Cambiar «escríbeme un guión» por «imagina que eres un creador con 500.000 suscriptores, ¿cómo escribirías este guión para tu canal?» puede cambiar radicalmente el resultado.

- Añadir restricciones: las restricciones fuerzan creatividad y precisión. Indicar un máximo de palabras, prohibir ciertos términos o pedir un formato concreto orienta al modelo hacia resultados más específicos.

- El metaprompting: cuando no sabes cómo empezar

Si no tienes claro cómo construir el prompt para conseguir lo que quieres, puedes pedirle a la IA que lo haga por ti. Este enfoque se llama metaprompting.

Funciona de dos maneras:

- Preguntas guiadas: le explicas qué quieres conseguir y le pides que te haga las preguntas necesarias para darte la mejor solución. La IA actúa como un copiloto que te ayuda a identificar qué información necesitas para trabajar bien.

- Generación directa del prompt: le describes el objetivo y le pides que escriba directamente la instrucción más adecuada para alcanzarlo.

En ambos casos, la IA se convierte en una herramienta para mejorar tu forma de comunicarte con ella.

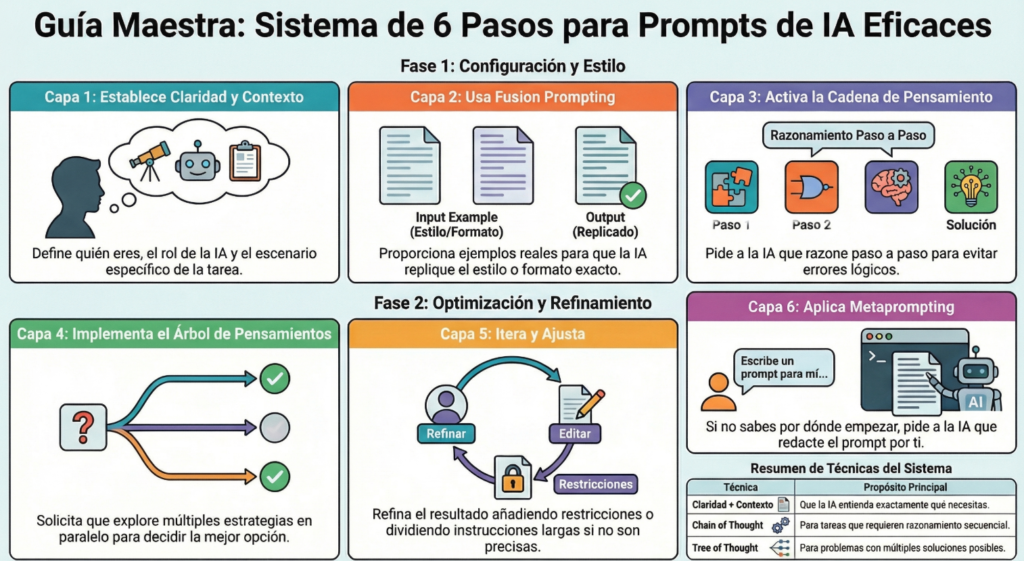

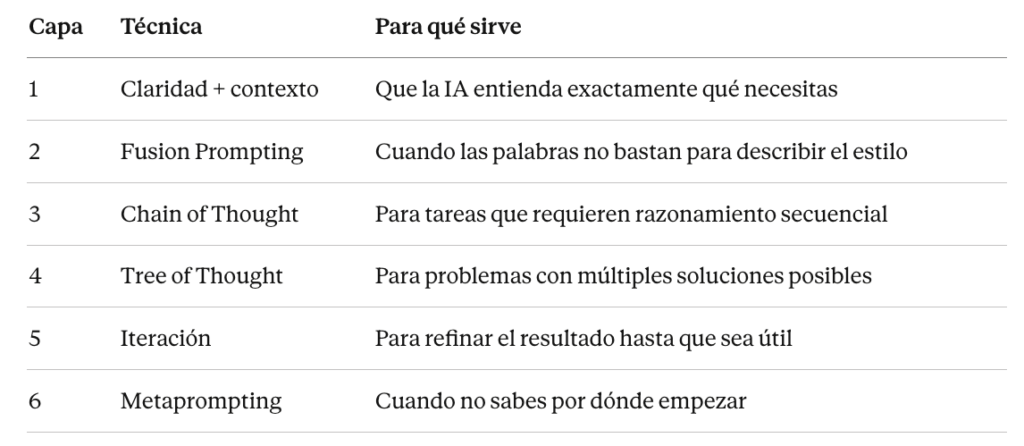

- El sistema completo

Todas estas técnicas forman un sistema coherente. No son trucos aislados, sino capas que se complementan:

Aplicar este sistema de forma consistente es lo que separa a los usuarios que se frustran con la IA de los que la usan para ahorrar tiempo y obtener resultados de calidad.